티스토리 뷰

728x90

[Day 36] 모델 경량화 - 2

1. 강의 복습 내용

더보기

Search Space

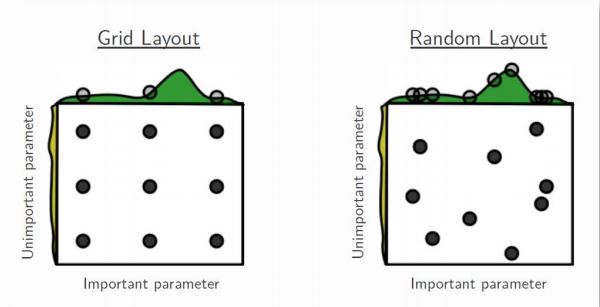

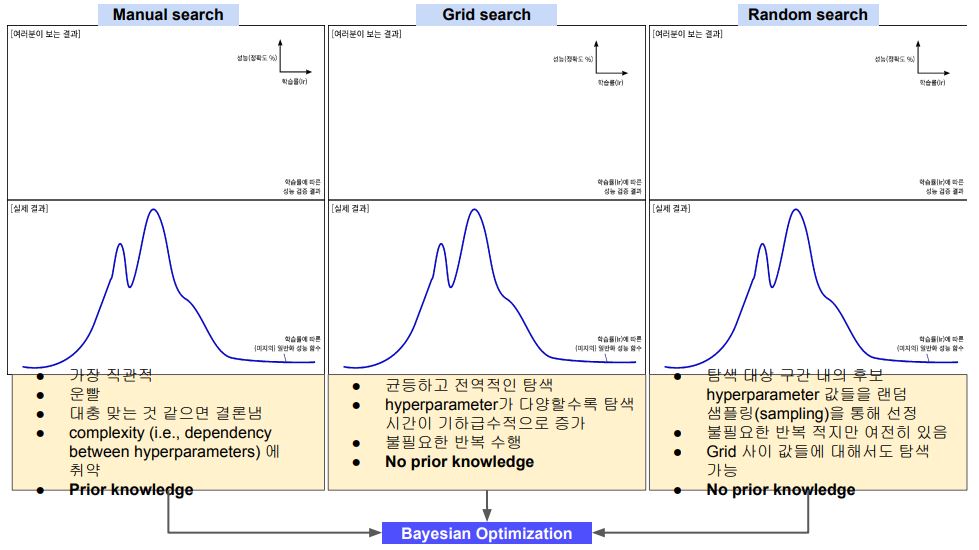

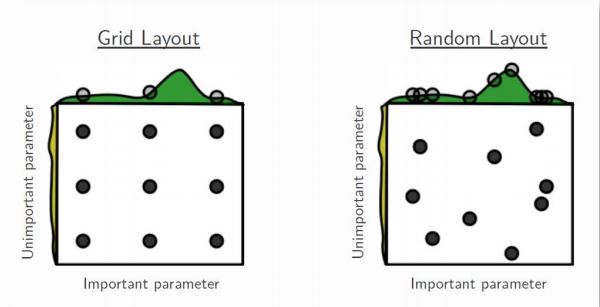

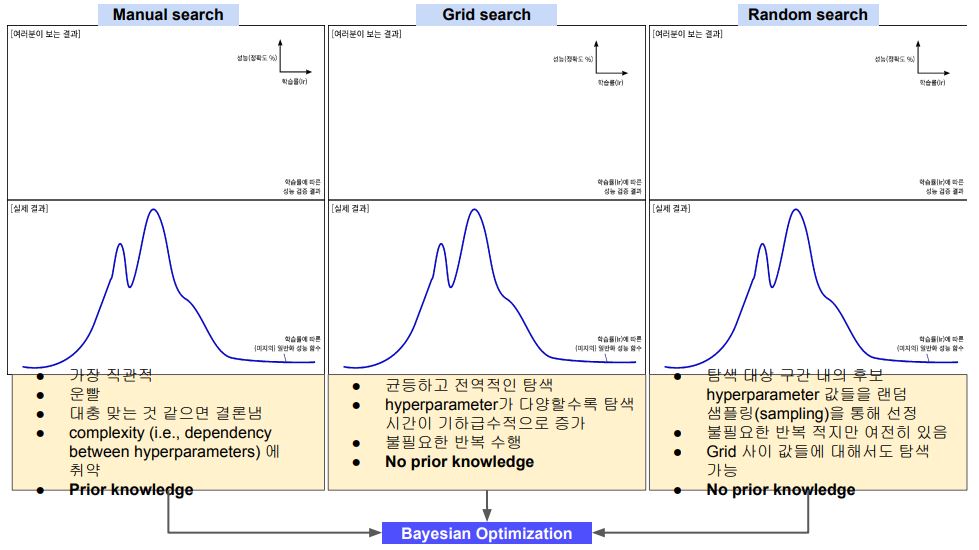

다양한 Hyperparameter Search

Hyperparameter를 찾기 위해 새로운 모델을 학습시키는 방법도 존재

가우시안 분포를 이용한 Hyperparameter Search

모델 경량화 - 2

1. Parameter Search

: 모델 최적의 Weight를 찾는 방법

- Parameter Search의 cost는 비교적 적다.

- Model의 의존도가 비교적 낮음

- Adam, SGD 등이 이것에 해당

2. Hyperparameter Search

: 얻는 과정의 Cost가 크다. (모델을 다시 학습시키고 결과를 얻는 루틴을 다시 돌아야함)

: Hyperparameter에 Model의 의존성이 큼 (Hyperparameter의 변동에 따라 Output이 크게 변화)

: 따라서 기존의 Search 방법과는 다른 연구들이 많이 진행중

- 좀 더 적은 비용으로 유의미한 (좀 더 많은 탐색) 결과를 얻기 위한 다양한 연구

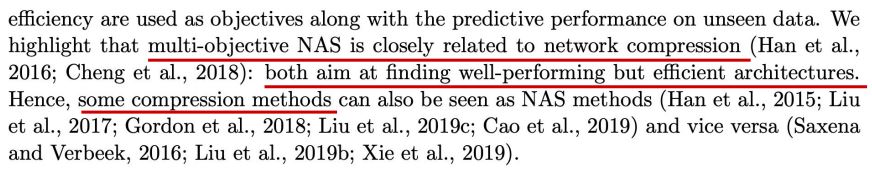

3. Neural Architecture Search (NAS)

*) Automatic NAS

- Search strategy는 Validation Set에서의 정확도와 같은 성능 측정을 최대화하는 Neural Architecture를 찾는 것을 목표로 한다.

2. 피어 세션

더보기

1. 강의 내용에 대한 토의

- Further Question

- Toy Code 토의

- 주사위 Maximum 엔트로피 계산

2. Image Classification TASK 논의 (경진대회 관련)

- 의견 공유

- Task 관련 아이디어 공유

3. Conclusion

더보기

1. 경진대회 TASK 계속 고민해보기 (Image Classification인데 +알파가 필요함)

2. 강의 내용 이해안되는 부분 복습하고 레퍼런스 참조

3. 토이 코드 더 뜯어보기

'부스트캠프 AI Tech > 학습정리' 카테고리의 다른 글

| [Day 38] 모델 경량화 - 4 (0) | 2021.03.18 |

|---|---|

| [Day 37] 모델 경량화 - 3 (0) | 2021.03.17 |

| [Day 35] 모델 경량화 - 1 (0) | 2021.03.15 |

| [Day 34] Computer Vision (CV) - 5 (0) | 2021.03.12 |

| [Day 33] Computer Vision (CV) - 4 (0) | 2021.03.11 |

댓글

공지사항

최근에 올라온 글

최근에 달린 댓글

- Total

- Today

- Yesterday

링크

TAG

- cnn

- 공공데이터

- Vision AI 경진대회

- 다이나믹프로그래밍

- pandas

- dfs

- P-Stage

- 프로그래머스

- Unet 구현

- DACON

- 네트워킹데이

- 백준

- 코딩테스트

- C++

- DeepLearning

- 알고리즘

- Unet

- NLP 구현

- Data Handling

- 데이터연습

- ResNet

- 부스트캠프 AI Tech

- AI 프로젝트

- 백트래킹

- python

- 이분탐색

- 그리디

- 동적계획법

- 데이터핸들링

- 브루트포스

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 | 31 |

글 보관함